La disputa entre el Pentágono y Anthropic reaviva el debate sobre el uso de la IA en los sistemas militares. A raíz de los llamamientos del Papa León XIV contra la «desresponsabilidad» en las decisiones de vida o muerte, la filósofa Mariarosaria Taddeo, profesora en el Oxford Internet Institute, advierte: los estándares de control siguen siendo frágiles, la responsabilidad moral no se atribuye a las máquinas y, más allá de ciertos límites, la adopción de la IA se vuelve «moralmente inaceptable»

(vaticannews.va/it).-La división entre el Departamento de Guerra de EE. UU. y la empresa Anthropic sobre el uso «sin restricciones» del modelo Claude en el ejército ha traído de nuevo una cuestión crucial al centro: ¿hasta qué punto es permisible delegar decisiones que afectan a la vida o la muerte a las máquinas? La negativa del CEO Dario Amodei a autorizar la vigilancia masiva y armas totalmente autónomas, que resultó en la orden de la administración estadounidense de suspender el uso de los sistemas de la empresa, pone de manifiesto la creciente tensión entre la seguridad nacional y la ética de la inteligencia artificial.

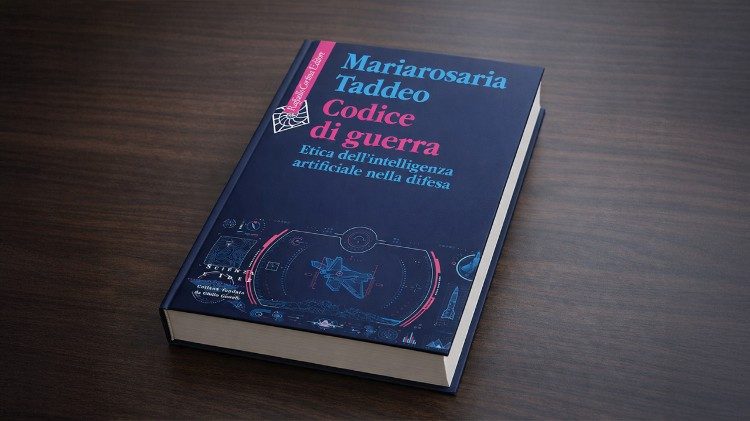

Un nudo que el papa León XIV resolvió con palabras claras. En su Mensaje para el Día Mundial de la Paz 2026, el Pontífice advirtió sobre el riesgo de una «espiral destructiva» y un proceso de «desresponsabilidad de los líderes políticos y militares, debido a la creciente ‘delegación’ a máquinas de decisiones sobre la vida y muerte de las personas humanas». En su discurso en la Conferencia anual sobre Inteligencia Artificial en junio de 2025, recordó que la IA es «ante todo una herramienta» y que debe evaluarse a la luz del «desarrollo integral de la persona y la sociedad». Este es el escenario en el que Mariarosaria Taddeo, profesora de Ética Digital y Tecnologías de Defensa en el Oxford Internet Institute y autora del libro Code of War, habló ante los medios vaticanos. Ética de la Inteligencia Artificial en Defensa (RaffaelloCortina editore, 2025).

Previsibilidad y control: regulación aún frágil

En cuanto a los estándares técnicos y regulatorios capaces de garantizar un control real de los sistemas de IA en defensa, Taddeo observa que las herramientas disponibles hoy en día son «muy pocas en la realidad», porque la previsibilidad de estos sistemas es «un asunto complejo»: son máquinas que aprenden de las interacciones con el entorno y, en este aprendizaje, «Todo lo que no está explícitamente prohibido se convierte en un posible resultado». Quienes las desarrollen, añade, deberían poseer «una capacidad predictiva casi divina». A esto se suma la «muy baja robustez desde un punto de vista técnico»: cuando el entorno operativo es diferente al entorno de entrenamiento, pueden surgir «resultados inesperados e inesperados», además de problemas críticos relacionados con la ciberseguridad.

A nivel regulatorio, el académico señala que existe «solo una regulación», la europea, basada en el riesgo y no en el control. Los otros enfoques, en su opinión, son «muy vacíos y muy superficiales» y están defectuosos por la idea de que la IA solo debería controlarse en la fase de diseño o aguas abajo de su uso. En realidad, una tecnología con autonomía y capacidad de aprendizaje requiere «monitorización constante, a lo largo del ciclo de vida», pero estos son estándares «más difíciles de diseñar e implementar».

Responsabilidad moral y el límite de la atrocidad

Sobre el tema de los sistemas de armas autónomos, Taddeo afirma que la decisión sobre la vida y la muerte permanece «sin una atribución de responsabilidad moral que sea correcta y justificable». Es posible atribuir la responsabilidad legal —por ejemplo, a un general o a un ministro— pero «la responsabilidad legal no siempre es congruente con la responsabilidad moral». Esto último, argumenta, «sigue siendo imposible de atribuir de manera justificada y aceptable, cuando las máquinas realizan acciones que afectan la vida de otro ser humano». El hecho de que el problema sea «irresoluble» representa un «caso límite» que indica la existencia de usos «moralmente inaceptables» de agentes artificiales.

Recordando los juicios de Núremberg, Taddeo recuerda que los jueces enfatizaron la necesidad de determinar la responsabilidad individual. En la guerra, la responsabilidad moral es «uno de los factores que se considera que limitan el riesgo de que la guerra se convierta en una atrocidad.» Si no puede atribuirse desde el principio, es necesario reconocer «un límite serio en la adopción de la inteligencia artificial», porque más allá de ese límite se pasa «del contexto de la guerra al contexto de la atrocidad y la inmoralidad.»

Mariarosaria Taddeo, profesora de Ética Digital y Tecnologías de Defensa en el Oxford Internet Institute de la Universidad de Oxford

Derecho humanitario y el enfoque «traslacional»

En cuanto a la relación entre la IA y el derecho internacional humanitario, teniendo en cuenta que la IA está redefiniendo la guerra, especialmente en las llamadas operaciones «no cinéticas», Taddeo aclara que las nuevas regulaciones no pueden ignorar los principios ya consagrados. Debe asegurarse de que la IA respete, por ejemplo, el principio de discriminación y la protección de los no combatientes. Sin embargo, aplicar estos principios requiere «un análisis algo más concreto y algunas fórmulas nuevas». Cita el artículo 36 del Primer Protocolo Adicional a las Convenciones de Ginebra, que exige que las armas sean probadas antes de su uso. En el caso de la IA, sin embargo, «técnicamente, cada vez que el sistema aprende algo nuevo se convierte en un arma nueva», lo que requeriría pruebas constantes, una solución «poco práctica». No necesitamos nuevos principios, sino «una forma que nos permita satisfacer este artículo de una manera factible y aceptable».

El enfoque que ella denomina «traslacional» implica traducir principios éticos en directrices operativas: trazabilidad de los procesos de toma de decisiones, estándares en el nivel de control humano, criterios de robustez y seguridad, identificación de «casos límite» sobre los que abrir un debate público. En cuanto a la reciente guerra en Gaza, recuerda la cifra del 10% de falsos positivos, ciudadanos no combatientes, en los sistemas militares de identificación de objetivos: determinar si este umbral es aceptable depende de los principios del derecho humanitario, que deben «ponerse en un contexto práctico». Hoy en día, observa, cuando se establecen límites, derivan más de la «conciencia civil de alguien» que de un marco regulatorio vinculante.

La contribución de la Iglesia y el vacío comunicativo

A la luz de la invitación del Papa León XIV a evaluar la IA según el desarrollo integral de la persona, Taddeo cree que la tradición católica puede ofrecer un llamado esencial a la empatía y al respeto por la dignidad humana, elementos capaces de evitar que la guerra «trascienda en formas de atrocidades y crímenes absolutos». La tradición de la «guerra justa», integrada en la cultura católica y occidental, también puede ejercer presión sobre el legislador para que la regulación sea más adecuada.

Dario Amodei, ex investigador de OpenAI y ahora CEO de Anthropic (AFP o licenciantes)

El autor también denuncia una «brecha comunicativa muy importante». La atención solo se centra en los «grandes casos» de los medios, explica Taddeo, como la reciente disputa entre Anthropic y el Pentágono, pero falta atención constante. La IA, señala, está siendo adoptada cada vez más por los sistemas de defensa de muchos países que disponen de presupuestos suficientes para este propósito; Esto conduce a una «erosión» interna, menos visible pero «constante y sistémica» del derecho internacional humanitario, que limita el poder del Estado. Si estos límites se debilitan en el ámbito militar, advierte, también podrían ser cuestionados en el ámbito civil. Por esta razón, se requiere mayor atención por parte de la política y la opinión pública: la defensa «es ahora un problema actual en nuestra sociedad» y se refiere a la forma en que los estados ejercen su poder.